复杂度分析

为什么需要复杂度分析

如果单纯的把代码跑一边,通过统计、监控的方式得到算法执行的时间和占用的内存大小,这种方法通常叫做事后统计法。事后统计法的局限性在于

- 测试结果非常依赖测试环境;

- 测试结果受数据规模的影响很大;

我们需要一个不用具体的测试数据来测试,就可以粗略地估计算法的执行效率的方法。

大 O 复杂度表示法

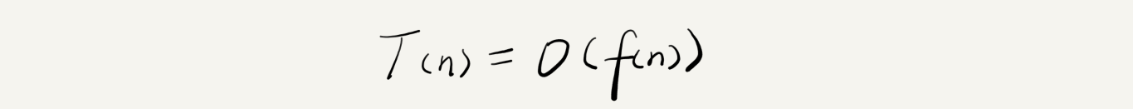

所有代码的执行时间 T(n) 与每行代码的执行次数 f(n) 成正比,n表示数据规模,公式中的O表示代码的执行时间T(n)与f(n)表达式成正比。

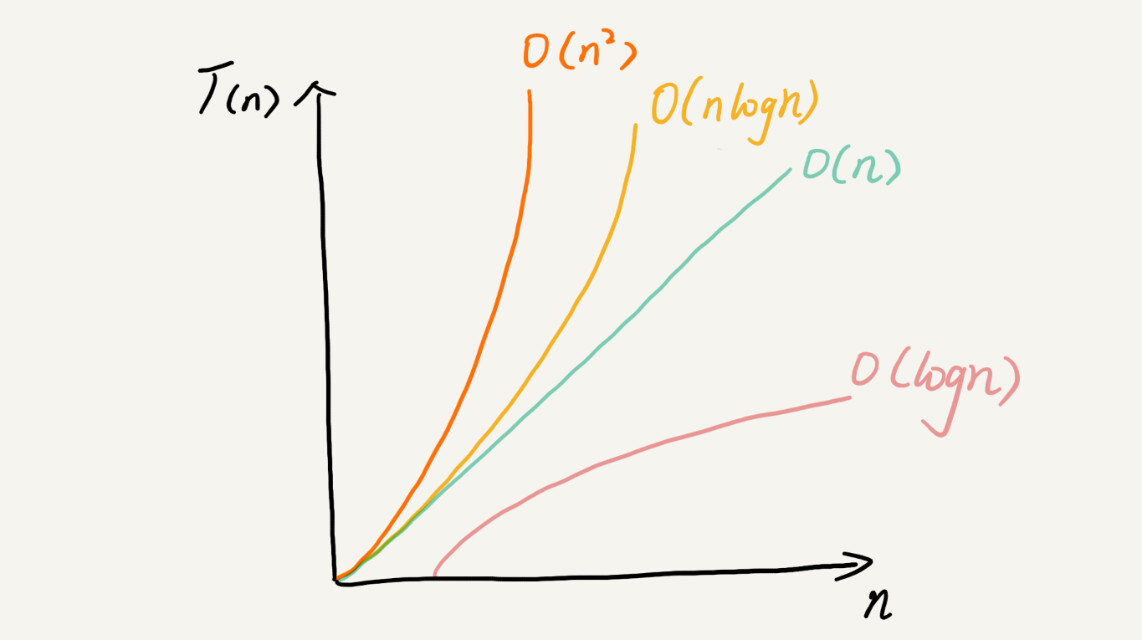

大 O 时间复杂度实际上并不具体表示代码真正的执行时间,而是表示代码执行时间随数据规模增长的变化趋势,所以,也叫作渐进时间复杂度(asymptotic time complexity),简称时间复杂度。

当n很大时,公式中的低阶、常量、系数三部分并不左右增长趋势,所以都可以忽略,我们只需记录一个最大量级就可以,例如T(n) = O(n)、T(n) = O(n2)。

时间复杂度分析

只关注循环执行次数最多的一段代码

我们在分析一个算法、一段代码的时间复杂度的时候,也只关注循环执行次数最多的那一段代码就可以了。例如下代码,总体时间复杂度位O(n)。

int cal(int n) {

int sum = 0;

int i = 1;

for (; i <= n; ++i) {

sum = sum + i;

}

return sum;

}加法法则:总复杂度等于量级最大的那段代码的复杂度

乘法法则:嵌套代码的复杂度等于嵌套内外代码复杂度的乘积

几种常见时间复杂度实例分析

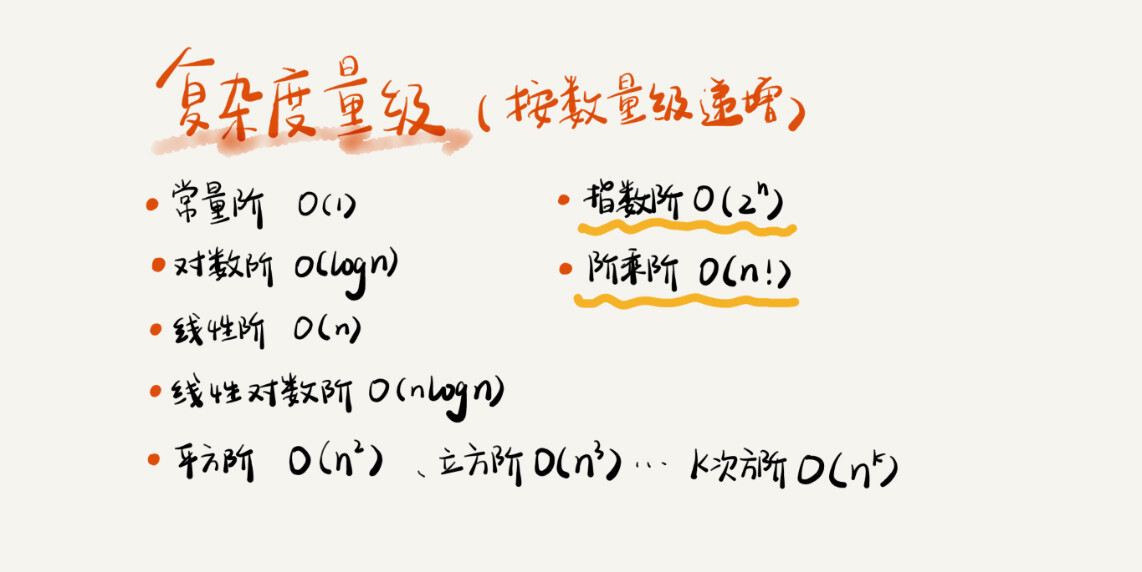

可以分为多项式量级和非多项式量级,我们把时间复杂度位非多项式量级的算法问题叫做NP问题,时间复杂度可以为O(2n) 和 O(n!)。二常见的多项式时间复杂度如下。

O(1)

一般情况下,只要算法中不存在循环语句、递归语句,即使有成千上万行的代码,其时间复杂度也是Ο(1)。

O(logn)、O(nlogn)

例如下列代码的时间复杂度为O(logn)

i=1;

while (i <= n) {

i = i * 2;

}如果一段代码的时间复杂度是 O(logn),我们循环执行 n 遍,时间复杂度就是 O(nlogn) 了。

O(m+n)、O(m*n)

代码的复杂度由两个数据的规模来决定。

空间复杂度

时间复杂度的全称是渐进时间复杂度*,表示算法的执行时间与数据规模之间的增长关系。类比一下,空间复杂度全称就是渐进空间复杂度(asymptotic space complexity),表示算法的存储空间与数据规模之间的增长关系。常见的空间复杂度就是 O(1)、O(n)、O(n^2)。

最好、最坏情况时间复杂度

最好情况时间复杂度:在最理想情况下,执行这段代码的时间复杂度。

最坏情况时间复杂度:在最坏情况下,执行这段代码的时间复杂度。

平均情况时间复杂度

平均时间复杂度的全称叫加权平均时间复杂度或者期望时间复杂度。

在大多数情况下,我们不需要区分最好、最坏、平均时间复杂度三种情况,只有同一块代码在不同的情况下,时间复杂度有量级的差距,我们才用这三种复杂度表示法来区分。

均摊时间复杂度

对一个数据结构进行一组连续操作中,大部分情况下时间复杂度都很低,只有个别情况下时间复杂度比较高,而且这些操作之间存在前后连贯的时序关系,这个时候,我们就可以将这一组操作放在一块儿分析,看是否能将较高时间复杂度那次操作的耗时,平摊到其他那些时间复杂度比较低的操作上。而且,在能够应用均摊时间复杂度分析的场合,一般均摊时间复杂度就等于最好情况时间复杂度。